API 비용 아끼는 무료 로컬 LLM Ollama 사용법 (M1 맥북 프로 실사용기)

개인적으로 만든 언어 학습 프로그램에 Claude API를 연동해서 단어마다 예문과 해석을 자동으로 생성하는 기능을 넣었다.

그런데 생각보다 API 비용이 든다. 단어 10개에 대한 예문을 생성하는 데 0.33 달러, 484원이라는 비용이 든다.

(2026년 3월 11일 기준 1,465원)

AI에게 특별히 어려운 작업을 시키는 것도 아닌데 생각보다 비용이 든다.

그러다 문득, 이 정도 작업이라면 굳이 외부 API를 쓸 필요가 없겠다는 생각이 들었다. 찾아보니 Ollama라는 로컬 LLM 실행 도구가 있었다. 오픈소스 언어 모델을 내 컴퓨터에서 직접 돌릴 수 있게 해주는 도구로, API 비용 없이 얼마든지 활용할 수 있다.

1. Ollama 설치 방법

Ollama 공식 사이트에서 운영체제별로 다운로드할 수 있다.

curl -fsSL https://ollama.com/install.sh | sh맥에서는 위 코드를 입력하여 설치해서 터미널에서 사용하거나, UI가 있는 프로그램을 따로 설치해서 사용할 수도 있다.

일단 본인은 터미널에서 사용해 보았다.

ollama --version위 코드를 입력해서 버전과 함께 ollama가 설치된 것을 확인하였다.

2. Ollama 사용방법

ollamaollama만 입력해도 실행할 수 있고 아직 설치된 모델이 없지만 "Run a model"을 선택하면

qwen2.5:7b라는 모델을 선택할지 묻는다. Yes를 선택하면 모델을 설치하기 시작한다. 기본으로 추천하는 모델 이외에도 다양한 모델이 있는데 ollama 라이브러리 사이트에서 확인하고 원하는 모델을 "ollama pull [모델명]" 입력해서 설치할 수 있다.

모델 관련 명령어

해당 모델로 실행

ollama run <model>

설치된 모델 목록 확인

ollama list

모델 다운로드

ollama pull <model>

모델 삭제

ollama rm <model>

모델 상세 정보 확인

ollama show <model>

3. Ollama 실사용

사용은 2020년에 출시한 메모리 8BG M1 맥북 프로에서 테스트해보았다.

간단한 인사부터 시작해서 간단한 코딩과 관련된 질문도 해보았고 대부분 막힘없이 술술 대답하였다.

아래의 명령어를 통해 질문한 내용에 대해 걸린 시간과 토큰 사용량을 확인할 수 있다.

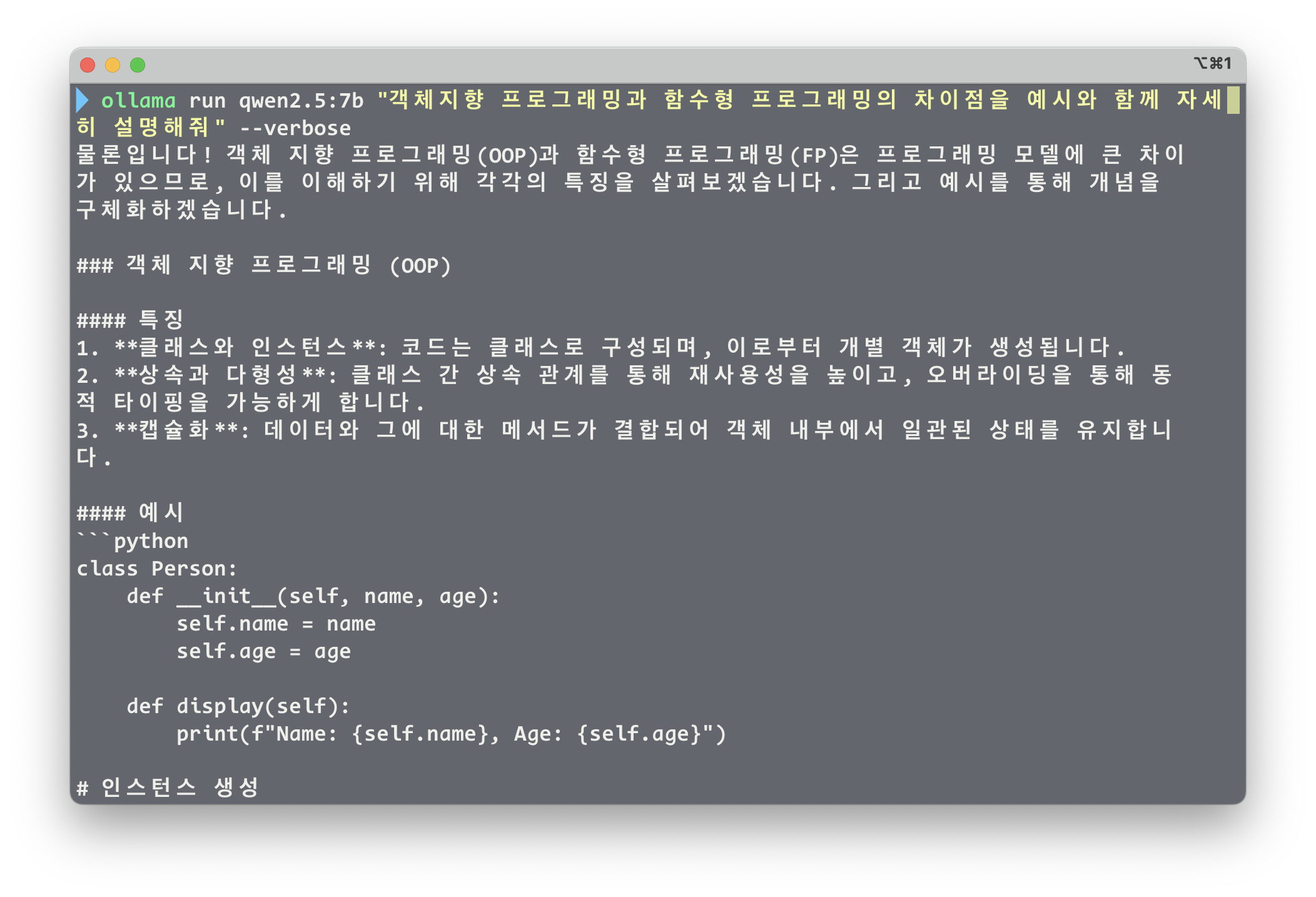

ollama run [모델명] "질문 내용" --verbose

간단하게 "Hello"를 입력해 봤더니 대답까지 총 5.47초 동안 전체 59개(입력 30개, 출력 29개)의 토큰을 사용했다.

조금 긴 내용을 한국어로 질문해 보았는데, 초반에는 PC가 느려짐도 없이 잘 설명하는 가 싶더니

마지막에 가서는 갑자기 한자로 출력하는 것을 확인할 수 있었다. 대답까지 총 1분 39초가 걸렸고 전체 805개(입력 58개, 출력 747개)의 토큰을 사용했다.

4. Ollama 후기

결론적으론 사용할만하다. 간단한 질문에는 답을 잘한다.

다만, PC로 다른 작업이 불가능할 정도로 심하게 느려지고 출력하는 시간도 분단위로 걸린다.

영어로 질문할 때는 그래도 잘 대답하는 느낌이지만, 한국어나 일본어로 질문을 하면 중간에 언어가 바뀌거나 애초에 다른 언어로 출력하기도 한다.

단어에 대한 예문을 만드는 작업을 하는 본인한테는 쓸만하다. 다만 AI를 돌려놓은 상태로는 아무것도 하지 못한다.

다른 작업은 하지 않고 AI만 돌려놓을 상태이고, 출력이 한 줄로 된 간단한 질문만 할다면 좋을 것이다.